Mitä tapahtuu kun feikkiä ei erota enää todellisuudesta? Microsoft-pomo huolissaan

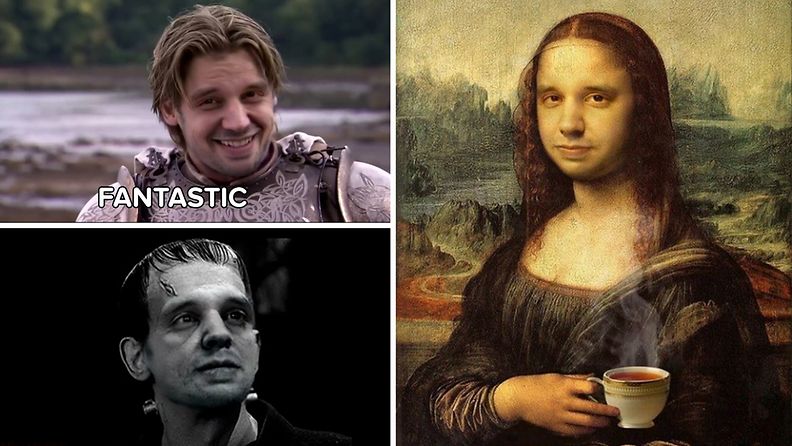

Tekniikan kehittyessä tietokoneen luomat grafiikat ovat nousemassa niin kovalle tasolle, että ihmisten alkaa olla hankala erottaa aitoa kuvaa väärennetystä.

Deepfake-ilmiöstä on nähty vain jäävuoren huippu ja uusia uhkia nousee esiin lähitulevaisuudessa. Kohta emme voi olla enää varmoja, onko videopuhelun toinen osapuoli oikea ihminen. Huijarit voivat myös luoda sarjoittain valevideoita tukemaan valheellisia väitteitään, varoittaa Microsoftin tieteellinen johtaja Eric Horvitz .

TechRadar kirjoittaa Horvitzin sanovan, että rikolliset ovat jo valmiita viemään väärennetyt videonsa seuraavalle tasolle. Väärennettyjen videoiden luominen onnistuu jo tällä hetkellä tekoälyn ja koneoppimisen avulla.

Deepfake-ilmiö on kehittymässä interaktiiviseksi, jossa käyttäjät voivat keskustella tyhjästä luodun vastapuolen kanssa. Toinen uhkakuva on koostetut deepfake-videot, jotka nivoutuvat ajan mittaan yhteen oikean maailman tapahtumien kanssa. Tämän avulla voidaan luoda niin kutsuttua vaihtoehtoista historiaa, joka saattaa vaikuttaa teknologian kehittyessä täysin aidolta.

Horvitz on huolissaan juuri deepfaken kehittymisestä siihen pisteeseen, että aitojen videoiden erottaminen väärennetyistä käy lähes mahdottomaksi. Hänen mukaansa lähitulevaisuuden deepfake-teknologia uhkaa viedä maailman kohti tiedon jälkeistä aikaa, jossa faktaa ei voi erottaa fiktiosta.

Uusimmat

-

23:54

Nuori mies on sytyttänyt itsensä palamaan Trumpin oikeudenkäynnin ulkopuolella

-

22:49

Tulikuuma maalitykki Leijoniin – kuusi uutta peluria MM-leiritykseen

-

22:24

Purra: Suomi ei hyväksynyt Kansainvälisen valuuttarahaston julkilausumatekstiä – yhteinen julkilausuma jäi antamatta

-

22:23

"Monsteri" on kuollut – kehonrakentajan vaimolta tiukka toive

-

22:18

Finnair ei lennä Israelin tai Iranin ilmatilassa

-

21:49

Oulussa etsitään yhä kadonnutta naista

-

21:47

Kärppäkapteeni Atte Ohtamaa, 36, paljasti tehneensä isoja päätöksiä – "Pakko myöntää itsellekin"

-

21:26

Ogier tykitti hirmuvedon päivän päätteeksi – Kroatian MM-rallin kärjessä melkoinen tilanne: MTV seurasi

-

21:24

Kärpät palasi mitalikantaan SM-liigassa! Tähtipelaaja huudatti kotiyleisöä jatkoerässä

-

21:15

Nainen kävi yksillä Tinder-treffeillä miehen kanssa – seurasi lähes viisi vuotta vainoamista

-

21:15

Suosikkitubettaja jätti ilmoittamatta yli 180 000 euron tulot – tuomittiin ehdolliseen vankeuteen

-

20:56

Leijonilta ryhtiliike – Ruotsi kaatui jatkoajalla

-

20:52

Tilastokeskuksen asiantuntija: Alv-nosto vaikuttaa eniten pienituloisimpiin

-

20:51

Jari-Matti Latvala mietti jo synkkiä: "Ei mitään mahdollisuuksia" – suoraa puhetta Sébastien Ogierista

-

20:32

Inter edelleen ilman voittoa – Ilveksen ahdinko jatkuu

-

20:29

Epäily Ruotsissa: Mies hyökkäsi kolmen naisen kimppuun – poliisi ampui epäiltyä

-

20:13

Hanna Pakarisen sydän alkoi oireilla ja laulaja hakeutui lääkäriin – diagnoosi oli jotain, mitä hän ei saattanut lainkaan odottaa

-

20:11

Nainen törmäsi sähköskootterilla rajusti 67-vuotiaaseen Briteissä – kuskilta yllättävä reaktio

-

20:04

WHO: Lintuinfluenssa H9N2 on tarttunut ihmiseen

-

20:00

Salkkarit-kurkistus julki! Hahmo ihmettelee: "Miksi haluat tämän työn?"

-

Lataa lisää